使用Amazon Bedrock Guardrails保护您的DeepSeek模型部署

生成式AI的快速发展,已将强大的公开大型语言模型(LLMs),如DeepSeek-R1,推向了创新的前沿。DeepSeek-R1模型现已在Amazon Bedrock Marketplace和Amazon SageMaker JumpStart上可用,而精简版则通过Amazon Bedrock Custom Model Import提供。据DeepSeek AI称,这些模型在推理、编码和自然语言理

生成式AI的快速发展,已将强大的公开大型语言模型(LLMs),如DeepSeek-R1,推向了创新的前沿。DeepSeek-R1模型现已在Amazon Bedrock Marketplace和Amazon SageMaker JumpStart上可用,而精简版则通过Amazon Bedrock Custom Model Import提供。据DeepSeek AI称,这些模型在推理、编码和自然语言理解方面展现了强大的能力。然而,与所有模型一样,它们在生产环境中的部署需要仔细考虑数据隐私要求、适当管理输出中的偏见,并需建立稳健的监控与控制机制。

采用开源、开放权重模型(如DeepSeek-R1)的组织,有机会解决几个关键问题:

增强安全措施以防止潜在滥用,参考资源如OWASP LLM Top 10和MITRE Atlas

确保敏感信息得到保护

推动负责任的內容生成实践

努力遵守相关行业法规

这些关注点在高度监管的行业中尤为关键,如医疗保健、金融和政府服务,其中数据隐私和内容准确性至关重要。

本博客文章提供了一份全面指南,说明如何使用Amazon Bedrock Guardrails为DeepSeek-R1及其他开放权重模型实施强大的安全保护。我们将探讨:

如何利用Amazon Bedrock提供的安全功能来保护你的数据和应用程序

实际实施护栏以防止提示攻击和过滤有害内容

实施一个深度防御的稳健策略

通过遵循本指南,你将学习如何在保持强大安全控制的同时,利用DeepSeek模型的高级能力,并促进伦理AI实践。无论是开发面向客户的生成式AI应用还是内部工具,这些实施模式都将帮助你满足安全与负责任AI的需求。通过这一步步的方法,组织可以按照AI安全与保障的最佳实践部署开放权重的大型语言模型,如DeepSeek-R1。

DeepSeek模型及其在Amazon Bedrock上的部署

DeepSeek AI,一家专注于开放权重基础AI模型的公司,最近推出了他们的DeepSeek-R1模型。根据其论文,这些模型在行业基准测试中展现了卓越的推理能力和性能。根据第三方评估,这些模型在质量指数、科学推理与知识、定量推理和编码(HumanEval)等各项指标中均稳居前三。

该公司进一步扩展了其产品线,发布了基于Llama和Qwen架构的六款源自DeepSeek-R1的密集模型,并将其作为开放权重模型发布。这些模型现可通过亚马逊云科技生成式AI解决方案获取:DeepSeek-R1可通过Amazon Bedrock Marketplace和SageMaker Jumpstart访问,而基于Llama的精简版则可通过Amazon Bedrock Custom Model Import实现部署。

Amazon Bedrock提供了全面的安全功能,以帮助确保开源和开放权重模型的安全托管和操作,同时保持数据隐私和法规遵从性。关键功能包括静态和传输中的数据加密、细粒度访问控制、安全连接选项以及各种合规认证。此外,Amazon Bedrock还提供了内容过滤和敏感信息保护的护栏,以支持负责任的AI使用。亚马逊云科技通过广泛的平台级安全和合规措施进一步增强了这些能力:

数据加密:使用亚马逊云科技密钥管理服务(Amazon KMS)对静态和传输中的数据进行加密

访问管理:通过亚马逊云科技身份和访问管理(IAM)实现访问控制

网络安全:通过亚马逊云科技虚拟私有云(Amazon VPC)部署、VPC端点以及亚马逊云科技网络防火墙进行

TLS检查并执行严格的策略规则

服务控制策略(SCPs):用于亚马逊云科技账户级别的治理

安全组和网络访问控制列表(NACLs):用于限制访问

合规认证:包括HIPAA、SOC、ISO和GDPR

FedRAMP High授权:在Amazon GovCloud(美国西部)中为Amazon Bedrock提供高等级授权

监控与日志记录:通过Amazon CloudWatch和Amazon CloudTrail实现

在部署到生产环境时,组织应根据其特定的合规性和安全需求自定义这些安全设置。亚马逊云科技作为其安全流程的一部分,会对所有模型容器进行漏洞扫描,并仅接受Safetensors格式的模型,以帮助防止不安全的代码执行。

Amazon Bedrock 护栏

Amazon Bedrock Guardrails提供了可配置的安全保障措施,帮助大规模安全地构建生成式AI应用程序。Amazon Bedrock Guardrails还可以与Amazon Bedrock的其他工具集成,包括Amazon Bedrock Agents和Amazon Bedrock Knowledge Bases,构建更加安全、更符合负责任 AI 政策的生成式 AI 应用程序。如需了解更多信息,请参阅 [亚马逊云科技负责任 AI 页面](https://Amazon.amazon.com/responsible-ai/)。

核心功能

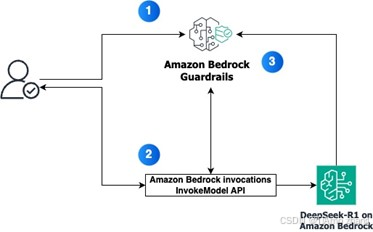

Amazon Bedrock Guardrails 可以通过两种方式使用。首先,它可以与InvokeModel和Converse API调用直接集成,在推理过程中对输入提示和模型输出应用护栏。此方法适用于通过Amazon Bedrock Marketplace和Amazon Bedrock Custom Model Import托管的模型。其次,ApplyGuardrail API提供了一种更灵活的方式,允许在不调用模型的情况下独立评估内容。这种方法适用于在应用程序的各个阶段评估输入或输出,或与非Amazon Bedrock的自定义或第三方模型配合使用。两种方法均可帮助开发者实现适合其用例的安全保障,确保生成式AI应用程序的安全和合规交互。

关键 Amazon Bedrock Guardrails 策略

Amazon Bedrock Guardrails提供以下可配置的护栏策略,帮助安全地大规模构建生成式AI应用程序:

内容过滤器

可调节的有害内容过滤强度

预定义类别:仇恨、侮辱、性内容、暴力、不当行为和提示攻击

支持多模态内容,包括文本和图像(预览版)

主题过滤器

限制特定主题的能力

防止查询和响应中出现未经授权的主题词汇过滤器

阻止特定的单词、短语和粗俗语言

可自定义过滤器,用于屏蔽冒犯性语言或竞争对手的引用敏感信息过滤器

阻止或掩码个人身份信息(PII)

支持自定义正则表达式模式

对标准格式(如社保号、出生日期和地址)进行概率检测上下文基础检查

通过源基础检测幻觉

查询相关性验证

自动推理检查以防止幻觉(预览版)其他功能

模型无关的实现:

兼容所有Amazon Bedrock基础模型

支持微调模型

通过ApplyGuardrail API扩展到外部自定义和第三方模型

这一全面的框架帮助客户实施负责任AI,确保在多样化的生成式AI应用中维护内容安全和用户隐私。

护栏配置

创建一个护栏,根据您的用例配置特定策略。

与InvokeModel API集成

在请求中调用Amazon Bedrock InvokeModel API并指定护栏标识符。

进行API调用时,Amazon Bedrock会将指定的护栏应用于输入和输出。

护栏评估流程

1. 输入评估:在将提示发送给模型之前,护栏根据配置的策略评估用户输入。

2. 并行策略检查:为提高延迟性能,输入会针对每个配置的策略并行评估。

3. 输入干预:如果输入违反任何护栏策略,则返回预配置的阻止消息,并丢弃模型推理。

4. 模型推理:如果输入通过护栏检查,提示将发送给指定模型进行推理。

5. 输出评估:模型生成响应后,护栏根据配置的策略评估输出。

6. 输出干预:如果模型响应违反任何护栏策略,将根据策略返回预配置的阻止消息或屏蔽敏感信息。

7. 响应交付:如果输出通过所有护栏检查,响应将未经修改地返回给应用程序。

前提条件

在使用Amazon Bedrock Custom Model Import功能导入的模型上设置护栏之前,请确保满足以下前提条件:

拥有访问Amazon Bedrock的 亚马逊云科技账户以及具有必要权限的IAM角色。建议使用Amazon IAM Identity Center进行集中访问管理。

确保已使用Amazon Bedrock Custom Model Import服务导入自定义模型。DeepSeek-R1-Distill-Llama-8B可使用Amazon Bedrock Custom Model Import导入,您有两个部署选项:

按照 [部署 DeepSeek-R1精简版Llama模型](https://Amazon.amazon.com/blogs/machine-learning/deploy-deepseek-r1-distilled-llama-models/) 的说明进行操作。

使用 [Amazon-samples](https://github.com/Amazon-samples) 提供的笔记本进行部署。

您可以使用 亚马逊云科技管理控制台创建护栏,也可以按照[此笔记本](https://github.com/Amazon-samples/amazon-bedrock-custom-model-guardrails)以编程方式创建护栏。该笔记本执行以下操作:

安装所需的依赖项

使用boto3 API创建护栏并配置过滤器以满足前述用例

为导入的模型配置分词器

使用提示测试Amazon Bedrock Guardrails,展示各种护栏过滤器的功能

深度防御策略与 亚马逊云科技服务

尽管Amazon Bedrock Guardrails提供了基本的内容和提示安全控制,但在部署任何基础模型(尤其是开放权重模型如 DeepSeek-R1)时,实施全面的深度防御策略至关重要。有关与OWASP LLM Top 10 一致的深度防御方法的详细指南,请参阅我们之前的博客文章:[构建安全的生成式 AI 应用程序](https://Amazon.amazon.com/blogs/security/architecting-secure-generative-ai-applications/)。

关键亮点包括:

提升组织韧性:从安全角度出发,构建稳健的基础

基于安全的云基础:利用亚马逊云科技服务构建安全环境

应用分层防御策略:跨越多个信任边界

应对 OWASP LLM 应用十大风险

在 AI/ML 生命周期中实施安全最佳实践

结合 亚马逊云科技安全服务与 AI/ML 特定功能

考虑多样化视角,将安全与业务目标对齐

准备并缓解提示注入和数据中毒等风险

将模型级控制(护栏)与深度防御策略相结合,可以创建强大的安全态势,帮助防范以下威胁:

数据泄露尝试

对微调模型或训练数据的未授权访问

模型实现中的潜在漏洞

AI 代理和集成的恶意使用

我们建议在部署任何新的 AI/ML 解决方案之前,使用 亚马逊云科技生成式AI工作负载指南进行全面的威胁建模练习,以确保安全控制与特定风险场景和业务需求保持一致。

结论

为大型语言模型(包括 DeepSeek-R1 模型)实施安全保护,对于维护安全和伦理的AI环境至关重要。通过将Amazon Bedrock Guardrails与Amazon Bedrock InvokeModel API和 ApplyGuardrails API结合使用,您可以在利用其强大能力的同时,降低与高级语言模型相关的风险。然而,重要的是要认识到,模型级保护只是全面安全策略的一个组成部分。

本文概述的策略解决了使用Amazon Bedrock Custom Model Import、Amazon Bedrock Marketplace和Amazon SageMaker JumpStart托管的多种开放权重模型共有的关键安全问题,包括提示注入攻击的潜在漏洞、有害内容的生成以及近期评估中发现的其他风险。通过实施这些护栏并结合深度防御方法,组织可以显著降低滥用的风险,并更好地将AI应用与伦理标准和法规要求对齐。

随着AI技术的不断发展,优先考虑生成式AI的安全和负责任使用至关重要。Amazon Bedrock Guardrails提供了一个可配置且稳健的框架,用于实施这些保障措施,使开发者能够根据其特定用例和组织政策定制保护措施。我们强烈建议使用亚马逊云科技指南对您的AI工作负载进行全面的威胁建模,以评估安全风险并在整个技术堆栈中实施适当的控制。

请记住,定期审查和更新您的护栏以及所有安全控制措施,以应对新的潜在漏洞,并在快速发展的AI安全领域中保持对新兴威胁的防护。虽然今天我们重点关注DeepSeek-R1模型,但AI领域正在不断发展,新模型不断涌现。Amazon Bedrock Guardrails结合亚马逊云科技安全服务和最佳实践,提供了一个一致的安全框架,能够适应并保护您的生成式AI应用,无论是当前还是未来的开放权重模型。通过将安全视为评估、改进和适应的持续过程,组织可以自信地部署创新的AI解决方案,同时保持强大的安全控制。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)