NVIDIA Jetson Orin Nano 8G 开发板开箱测评:边缘AI设备的性价比之选

本文主要介绍了NVIDIA Jetson Orin Nano 8G 开发板开箱测评:边缘AI设备的性价比之选,希望对使用大语言模型的同学们有所帮助。

大家好,我是herosunly。985院校硕士毕业,现担任算法工程师一职,获得CSDN博客之星第一名,热衷于大模型算法的研究与应用。曾担任百度千帆大模型比赛、BPAA算法大赛评委,编写微软OpenAI考试认证指导手册。曾获得多项AI顶级比赛的Top名次,其中包括阿里云、科大讯飞比赛第一名,CCF、开放原子比赛二等奖。在技术创新领域拥有多项授权发明。曾辅导多位非科班出身的同学成功进入算法行业就业。希望和大家一起成长进步。

本文主要介绍了NVIDIA Jetson Orin Nano 8G 开发板开箱测评:边缘AI设备的性价比之选,希望对使用大语言模型的同学们有所帮助。

文章目录

1. 功能特性解析

作为NVIDIA边缘计算家族的新成员,Jetson Orin Nano 8G 凭借以下特性成为AI开发者的新宠:

1.1 硬件配置

- GPU:基于Ampere架构,配备1024个CUDA核心+32个Tensor核心,支持稀疏计算加速

- CPU:6核Arm Cortex-A78AE @1.7 GHz(通过软件升级解锁)

- 内存:8GB LPDDR5,带宽高达102GB/s

- AI算力:67 INT8 TOPS(升级后),较前代提升70%

1.2 接口扩展

- 显示输出:HDMI/DP接口

- 外设连接:4×USB 3.1、千兆网口、M.2 Key M/E扩展槽

- 传感器支持:40针GPIO、CSI摄像头接口

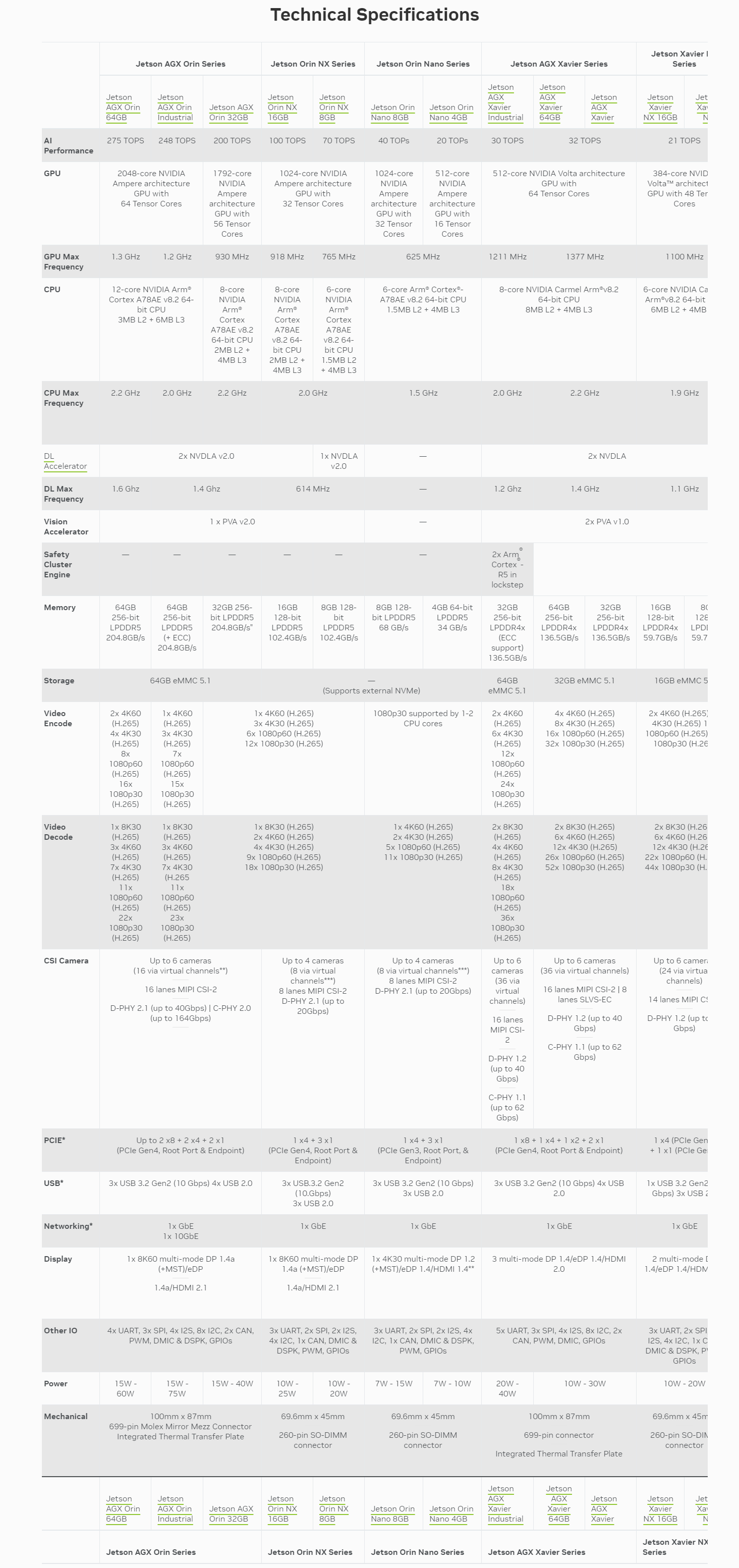

1.3 参数

| 特性 | 配置 |

|---|---|

| AI性能 | 40 TOPs |

| GPU | 1024-core NVIDIA Ampere architecture GPU with 32 Tensor Cores |

| GPU最大频率 | 625 MHz |

| CPU | 6-core Arm® Cortex®-A78AE v8.2 64-bit CPU <br1.5MB L2 + 4MB L3 |

| CPU最大频率 | 1.5 GHz |

| DL加速器 | — |

| DL最大频率 | — |

| 视觉加速器 | 2x PVA v1.0 |

| 安全集群引擎 | — |

| 内存 | 8GB 128-bit LPDDR5 68 GB/s |

| 存储 | 32GB eMMC 5.1 |

| 视频编码 | 1080p30 supported by 1-2 CPU cores |

| 视频解码 | 1x 4K60 (H.265) 2x 4K30 (H.265) 5x 1080p60 (H.265) 11x 1080p30 (H.265) |

| CSI摄像头 | Up to 4 cameras (8 via virtual channels) 8 lanes MIPI CSI-2 D-PHY 2.1 (up to 20Gbps) |

| PCIe | 1 x4 + 3 x1 (PCIe Gen3, Root Port, & Endpoint) |

| USB | 3x USB 3.2 Gen2 (10 Gbps) 3x USB 2.0 |

| 网络 | 1x GbE |

| 显示 | 1x 4K30 multi-mode DP 1.2 (+MST)/eDP 1.4/HDMI 1.4** |

| 其他IO | 3x UART, 2x SPI, 2x I2S, 4x I2C, 1x CAN, DMIC & DSPK, PWM, GPIOs |

| 功耗 | 7W - 15W |

| 机械规格 | 69.6mm x 45mm 260-pin SO-DIMM connector |

2. 系统安装

以下是基于NVIDIA Jetson Orin Nano开发板,将系统刷入M.2硬盘并实现从SSD启动的详细步骤:

2.1 准备工作

- 硬件要求

- 支持PCIe NVMe协议的M.2 SSD,使用前需要格式化为EXT4(推荐2280或2230规格,PCIe 3.0x4接口)。

- 一台安装Ubuntu 22.04(支持最新的SUPER模式) LTS的x86电脑或虚拟机(用于运行SDK Manager)。

- USB Type-C数据线(需要支持数据传输,不然没反应)、跳线冒或短接线(用于短接开发板进入刷机模式)。

- 一根DP线或DP–>HDMI的转换头

- 软件下载

- 从NVIDIA官网下载最新版SDK Manager(2.2.0版本)。

2.2 安装实物图

2.3 使用SDK Manager刷写系统到SSD

-

安装sdkmanager,第一次执行一般会失败,然后用“sudo apt --fix-broken install” 尝试修复。

说明:fix broken 是在 Debian 和基于 Debian 的 Linux 系统(如 Ubuntu)中,用于修复软件包安装过程中出现问题的命令。当你在安装软件包时遇到依赖关系错误或安装失败的情况,运行 sudo apt --fix-broken install 命令可以帮助修复这些问题。

-

运行sdkmanager,第一次需要登录(自行注册NVDIA developer账号)

设备默认没有检测到,需要把设备通过USB Type-C数据线连接到电脑或虚拟机(虚拟机的话需要通过虚拟机的可移动设备选项卡连接到设备)

这里只选择了安装基础的系统,不然太费时间了,安装组件可自行选择。

至此系统已经安装完成。移除跳线冒后,连接显示器,重启设备,将看到下面:

2.4 系统配置

- 更换清华源

# 做个备份

sudo cp /etc/apt/sources.list /etc/apt/sources.list.bak

# 编辑文件内容 把文件里的内容全部替换成下面的清华源

sudo vim /etc/apt/sources.list

# 默认注释了源码镜像以提高 apt update 速度,如有需要可自行取消注释

deb https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble main restricted universe multiverse

# deb-src https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble main restricted universe multiverse

deb https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble-updates main restricted universe multiverse

# deb-src https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble-updates main restricted universe multiverse

deb https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble-backports main restricted universe multiverse

# deb-src https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble-backports main restricted universe multiverse

# 以下安全更新软件源包含了官方源与镜像站配置,如有需要可自行修改注释切换

deb http://ports.ubuntu.com/ubuntu-ports/ noble-security main restricted universe multiverse

# deb-src http://ports.ubuntu.com/ubuntu-ports/ noble-security main restricted universe multiverse

# 预发布软件源,不建议启用

# deb https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble-proposed main restricted universe multiverse

# # deb-src https://mirrors.tuna.tsinghua.edu.cn/ubuntu-ports/ noble-proposed main restricted universe multiverse

# 这个时候你会发现更新速度很快很快

sudo apt-get update # apt的资源列表,没有真正的对系统执行更新

sudo apt-get upgrade # 把本地已安装的软件,与刚下载的软件列表里对应软件进行对比,如果发现已安装的软件版本太低,就会提示你更新。

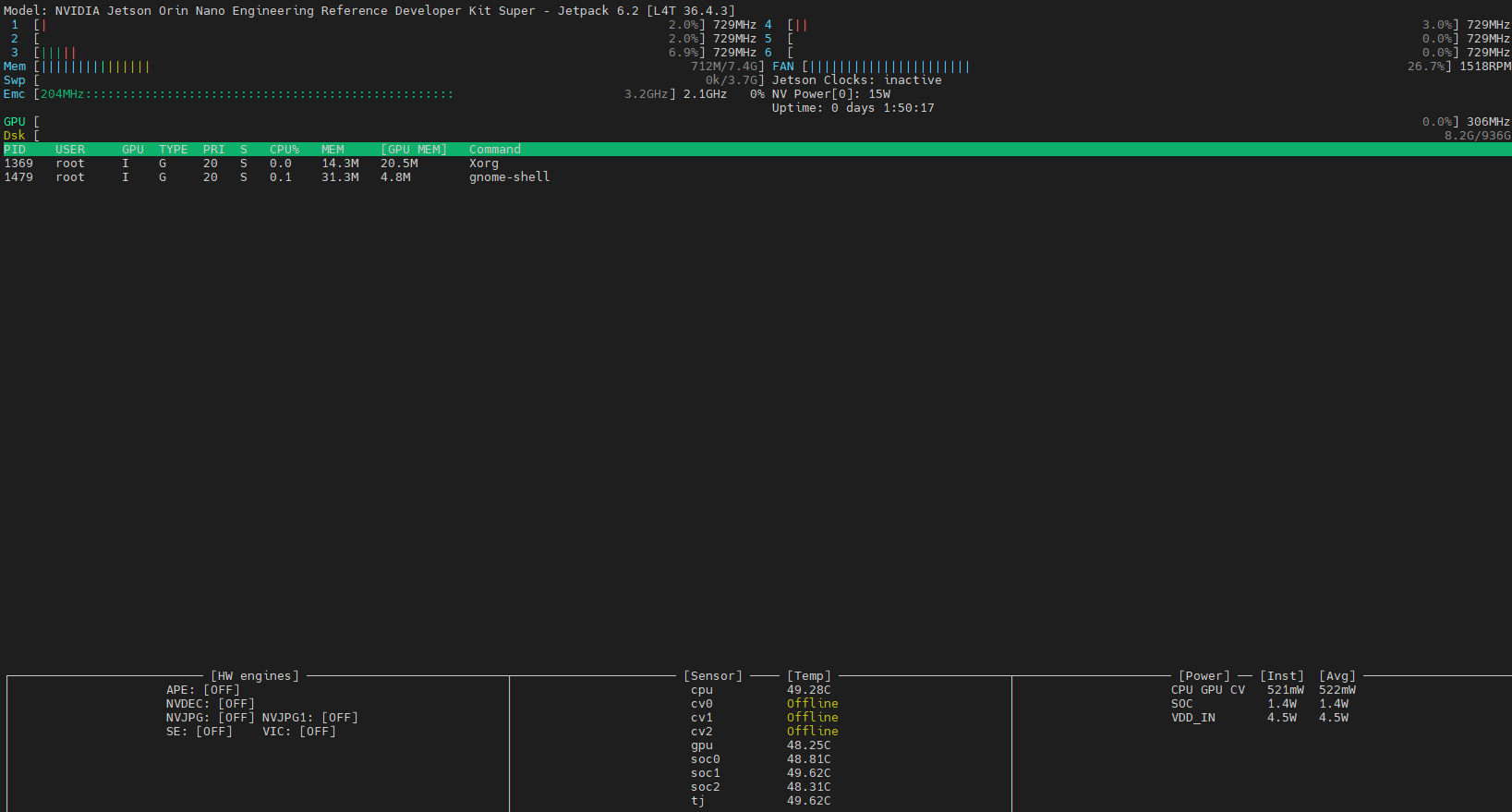

- 安装jtop

# 安装pip3

sudo apt-get install python3-pip python3-dev

# 升级并更新 pip3

sudo pip3 install --upgrade pip

# 安装jtop

sudo -H pip install -U jetson-stats

# 重启

sudo reboot

# jtop 测试

参考资料:

官网安装指南:https://www.jetson-ai-lab.com/initial_setup_jon_sdkm.html

B站视频安装:https://www.bilibili.com/video/BV15Acge1Er8/?spm_id_from=333.1391.0.0&vd_source=231fdcd27d4e1de9bf60d65152532589

3. 性能对比

Jetson 家族:

跟之前老的 Jetson nano 对比,就会发现 Orin Nano 的性能是数量级上的提升。根据官方给出的数据,Orin Nano 达到了 每秒40万亿次运算(TOPS)的AI性能,是之前 nano 的80倍,MAXN Super模式下AI算力更是达到了惊人的达67 TOPS。

这里有一个更直观的示例:基于PeopleNet Transformer的人物检测程序。官方提供的Docker容器极大简化了部署流程,用户仅需执行几条简单命令即可完成环境配置、模型下载和实时检测的全流程操作。

实测性能表现方面,在JetPack 6.1rev.1环境下实测,Jetson Orin Nano 8GB运行PeopleNet v3.1模型可实现12.5 FPS推理速度(MAXN Super模式)。对于智慧养老、零售分析等延迟容忍场景已完全适用,若需实时处理4K视频流,可切换至AGX Orin平台实现32 FPS的满帧率运算。

通过深度测试分析,Jetson Orin Nano展现出三大核心优势:

- 边缘部署新标杆

- 微型化设计:79mm×45mm模组封装,支持-40°C至85°C宽温运行

- 革命性算力:MAXN Super模式下AI算力达67 TOPS(稀疏计算),内存带宽102 GB/s

- 动态功耗管理:支持7W/15W/25W/MAXN Super四级模式切换

- 开发环境升级

- 预装JetPack 6.2 SDK(CUDA 12.6.10, TensorRT 10.3.0, cuDNN 9.2.0)

- 深度集成TAO Toolkit 6.0,支持PyTorch 3.0模型量化与转换

- 新增Omniverse Replicator 3.0扩展,实现物理级精确的合成数据生成

- 应用场景拓展

- 原生支持Llama-3.1-8B大语言模型,推理速度较前代提升63%

- 通过DeepStream 7.2实现多路视频流并行分析(最高支持8路1080P)

从产品定位来看,该设备既可作为轻量级AI应用的部署终端,也可作为学习边缘AI开发的实验平台。值得注意的是,NVIDIA NGC目录为Jetson系列提供了丰富的预置模型(包括PeopleNet、BodyPoseNet等),开发者可通过容器化部署快速构建POC验证系统,这为算法工程化落地节省了大量环境配置时间。

其他AI demo详见:https://github.com/dusty-nv/jetson-inference

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)