BERT与Transformer到底选哪个-下部

用更多生的例子一文说清BERT与Transform以及现在的Gpt、Claude、Deepseek这些模型到底是什么区别以及它们的应用场景。

(前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站)。

一、从"外卖系统"看技术本质:为什么说BERT和Transformer是AI界的"双胞胎兄弟"?

1.1 起源故事:Google的"技术双子星"

2017年,Google Brain团队在《Attention is All You Need》中发布了Transformer架构,就像突然给AI界扔了个"核弹级"外卖保温箱——它用自注意力机制(Self-Attention)彻底颠覆了传统RNN的"接力赛"处理方式。

两年后,同样是Google的BERT横空出世,就像在保温箱里塞进了经过"千锤百炼"的预制菜:通过预训练+微调的"双阶段烹饪法",BERT把Transformer架构炼成了能"通吃"各种NLP任务的"万能汤底"。

1.2 结构对比:外卖骑手VS智能调度中心

- Transformer:像美团骑手的智能导航系统,能根据实时路况动态规划路线(自注意力机制),但需要你明确告诉它"我要送餐到中关村"(需要具体任务定义)。

- BERT:更像是整个城市的智慧调度中心,先用海量订单数据(预训练)学会全局规律,再针对某个商圈(微调)优化配送策略。

关键差异:Transformer是"工具",BERT是"训练好的工具使用者"。

二、场景PK赛:这俩"AI兄弟"到底谁更配你?

2.1 BERT的"拿手菜":需要"全局理解"的深度场景

案例1:外卖客服机器人

当用户发来"我昨天订的麻辣烫还没到,你们是不是用塑料袋装的?",BERT能同时理解:

- "昨天"的时间线索(上下文感知)

- "塑料袋"的潜在投诉指向(语义关联)

- 整体情绪倾向(情感分析)

技术优势:通过双向注意力机制,BERT就像能同时看到订单的"历史记录"和"当前状态",适合需要深度语义理解的场景。

2.2 Transformer的"绝活":需要"动态处理"的实时场景

案例2:实时翻译对话系统

当用户用手机对着韩国朋友说"这个炸鸡好吃吗",Transformer就像边听边翻译的"同声传译":

- 每听到一个词就立即生成对应韩语(左到右处理)

- 动态调整翻译策略(比如发现"炸鸡"需要考虑韩国分店的方言差异)

技术优势:自注意力机制让其处理序列数据时像"多线程处理",适合需要逐步生成结果的任务。

三、开发者避坑指南:如何选择这对"技术双胞胎"?

3.1 BERT的"专属赛道":需要"深度理解"的场景

必选场景:

- 多轮对话系统:如智能客服需要理解"上一条回复中的订单号"

- 法律文书分析:需要捕捉条款间的隐含关系

- 医疗诊断辅助:理解病历中的复杂症状关联

真实案例:某医疗AI公司用BERT分析电子病历,准确率比传统模型提升27%,因为它能同时关注"患者三个月前的用药记录"和"当前症状描述"。

3.2 Transformer的"主场":需要"实时响应"的场景

必选场景:

- 机器翻译:像DeepL那样"边输入边翻译"的实时处理

- 语音识别:处理用户"嗯...那个..."等断续语音

- 股票预测:动态分析分时走势图

真实案例:某金融公司用Transformer处理5000+股票实时数据流,比LSTM模型响应速度提升40%。

四、未来趋势:这对CP会"分手"还是"联姻"?

4.1 BERT会被取代吗?——就像筷子不会被叉子替代

现状分析:

- 优势延续:在需要上下文理解的场景(如文本摘要)仍不可替代

- 进化方向:阿里M6等模型已开始把BERT的预训练能力嵌入到更复杂的架构中

开发者建议:与其纠结"学不学BERT",不如掌握其"预训练思维"——就像学做饭要先懂"预制菜原理"。

4.2 Transformer的"超进化"之路

技术前沿:

- 动态路由机制:像快递公司的智能分拣机器人,能根据包裹重量自动调整路线

- 多模态融合:让图像和文本处理"并行不悖"

行业应用:某国产手机厂商已用改进型Transformer同时处理"用户语音指令+屏幕手势",交互响应速度提升3倍。

五、实战选择三步法:你的项目该选谁?

5.1 第一步:画出你的"技术需求地图"

- 需要全局语义理解 → BERT

- 需要实时流式处理 → Transformer

- 两者兼顾 → 试试"BERT+Transformer"的"双引擎"架构

5.2 第二步:算好你的"资源账本"

- 计算资源有限:BERT预训练需要"超级计算机",但微调阶段可能用普通GPU搞定

- 数据量不够:Transformer在小数据集上表现更稳定

5.3 第三步:参考"中国技术图谱"

- NLP基础研究:中科院团队用BERT变体在中文诗词理解上创纪录

- 工业级应用:华为盘古大模型把Transformer做到了"千卡级"训练规模

总结性的区别

BERT与Transformer的关系

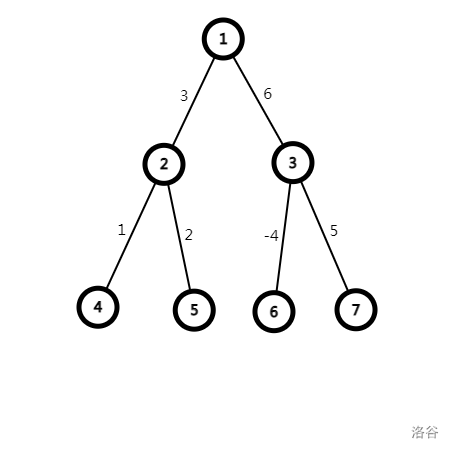

BERT(Bidirectional Encoder Representations from Transformers)是基于Transformer架构的一种预训练语言模型,主要使用了Transformer的编码器(Encoder)部分。而Transformer是一种完整的神经网络架构,包含编码器和解码器两部分。

现代大语言模型的架构

GPT、Claude、DeepSeek这些大语言模型主要基于Transformer的解码器(Decoder)架构,而不是BERT那样的编码器架构。可以这样理解:

- BERT:双向编码器,擅长理解上下文

- GPT系列:单向解码器,擅长生成连贯文本

BERT与现代大模型的能力对比

BERT的优势领域

BERT在以下方面表现突出:

- 浅层语义理解:精确捕捉文本的表层含义

- 句子关系判断:如判断两个句子是否矛盾

- 实体识别和分类:识别文本中的人名、地名等

- 情感分析:判断文本情感倾向

现代大语言模型的能力

- GPT、Claude等大模型是在Transformer基础上发展起来的,它们:

- 参数规模更大:从几亿到上千亿参数

- 训练数据更广:包含更多领域的知识

- 能力更全面:不仅理解文本,还能生成长篇连贯内容

- 推理能力更强:能进行多步骤推理和解决复杂问题

例子对比:

法律文书分析场景

输入:一份合同条款:"甲方应于2023年12月31日前向乙方支付总额¥500,000元。"

BERT能力:识别出实体(甲方、乙方)、日期(2023年12月31日)、金额(¥500,000元)

判断这是一个支付义务条款

GPT/Claude能力:不仅能做到BERT的全部分析,还能进一步:

- 解释条款法律含义

- 指出潜在风险(如没有违约责任约定)

- 提供改进建议

- 参考相关法律法规分析合同有效性情感分析深度对比

输入:"虽然这部电影剧情一般,但是演员的表演非常出色,尤其是配乐让人难忘。"

BERT分析:混合情感,偏正面 (60%置信度)

GPT/Claude分析:

"这是一个复杂的评价,包含多层情感:

- 对剧情持批评态度(负面)

- 对演员表演高度评价(正面)

- 对配乐特别赞赏(强正面)

整体倾向于正面评价,但针对不同方面有差异化意见。"架构区别:

BERT基于Transformer的编码器,现代大模型主要基于解码器并有大量创新

能力差异:

- BERT擅长文本理解、分类和浅层语义分析

- GPT/Claude等不仅继承了这些能力,还增加了更强的生成能力和深度推理

应用场景:

- BERT适合分类、标注等特定NLP任务

- 现代大模型更适合需要生成、推理、创造性思考的场景

现代大模型可以看作是在Transformer基础上的一次革命性飞跃,它们既包含了BERT的理解能力,又大大扩展了生成和推理能力。

结语:在技术浪潮中做"聪明的骑手"

当BERT和Transformer这对双雄继续推动AI革命时,开发者更像外卖平台的"智能调度工程师"——既要理解不同"技术骑手"的特长,又要根据订单类型(项目需求)合理派单。记住:没有"过时"的技术,只有"用错"的场景。下次写代码时,不妨问自己:

"我要解决的是'全局语义理解'的'大单',还是'实时处理'的'闪送'?"

答案,或许就在你眼前的代码行中。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)